Nvidia Ampere

Nvidiaは本日、AIおよびHPCソフトウェアのスタック全体とともにARMアーキテクチャを備えたプロセッサのサポートをついに発表しました。 Nvidiaは、ポータブルゲーム、自動運転車、ロボット工学、組み込みAIコンピューティング向けのTegraチップやその他のシステムオンチップ製品にアーキテクチャを組み込んでいるため、ARMに精通しています。

なぜ今なのか?

ARMはしばらく前から存在していましたが、HPCシステムでの使用は数年まで存在していませんでした。ほとんどすべてのHPCシステムは、長い間使用されてきたIntelのチップを使用しており、その結果、優れたレガシーソフトウェアとライブラリがサポートされています。

長年にわたり、ARMは、アーキテクチャをx86チップの実行可能な代替手段にすることができるエコシステムを構築するためにたゆまぬ努力を重ねてきました。モンブランプロジェクトは、この方向への大きなイニシアチブでした。

Mont-Blancパートナーは、32ビット携帯電話テクノロジーに基づいてArm HPCテストシステムをゼロから構築し、ソフトウェアとツールを移植および調整して、Armソフトウェアエコシステムを作成する必要がありました。 2015年、モンブランは、2,000を超えるモバイルCPUを搭載した世界初のArmベースのHPCクラスターを導入しました。このシステムは、HPCにArmテクノロジーを使用することの実行可能性を実証するのに役立ちました。

- OAG

これらのイニシアチブはついに実を結び、ARMアーキテクチャを備えたチップが世界中のさまざまなHPCシステムでますます使用されています。

データセンターにおけるNvidiaのビジネス上の関心

NvidiaはすでにコンシューマーGPUビジネスの大部分を占めており、長年にわたってワークステーション用の立派なハードウェアおよびソフトウェアスタックを作成してきました。ソフトウェアの面では、AIとディープラーニングのワークロードに関連する多くのソリューションがあります。これらのワークロードはすべてGPUによって高速化できます。ここで、TeslaおよびVoltaGPUが登場します。

これは会社の財政を助けました、そしてに関する記事によると フォーブ KarlFreund著 ' NVIDIAの2019年第1四半期に、同社は再び予想を上回り、総収益が66%増加したことを報告しました。これには、注目を集めているデータセンタービジネスの71%の成長が含まれます(四半期で7億100万ドルに達しました)。 NVIDIAの場合、「データセンター」セグメントには、ハイパフォーマンスコンピューティング(HPC)、データセンターでホストされるグラフィックス、およびAIアクセラレータが含まれます。」

これらは、Nvidiaの投資家基調講演でも大きな話題となっています。 NvidiaがMellanoxを買収した後 ここに 、CEOのジェンスンフアンは、決定の背後にある洞察を共有し、次のように述べています。 戦略はデータセンターを倍増させており、ハイパフォーマンスコンピューティングテクノロジーの2つのリーダーを組み合わせて統合しています。私たちはハイパフォーマンスコンピューティングのための高速コンピューティングに焦点を当てており、メラノックスはハイパフォーマンスコンピューティングのためのネットワーキングとストレージに焦点を当てており、2つの会社を1つの屋根の下に統合しました。私たちのビジョンは、データセンターが今日世界で最も重要なコンピューターであり、将来、ワークロードが変化し続けるにつれて(人工知能とデータ分析によって実際にトリガーされる)、あらゆる種類の将来のデータセンターが高性能のように構築されることです。コンピューター。ハイパースケールデータセンターは、何十億もの人々にサービスと軽量コンピューティングを提供するために実際に作成されました。しかし、過去数年間、人工知能、機械学習、データ分析の出現により、データセンターに多大な負荷がかかりました。その理由は、データサイズと計算サイズが非常に大きいため、1つに収まらないためです。コンピューター。そのため、複数のコンピューターに分散する必要があり、これらのコンピューターを連携させるための高性能接続がますます重要になっています。これが、メラノックスが非常によく成長した理由であり、人々がSmartNICとインテリジェントファブリックおよびソフトウェア定義ネットワークについて話している理由です。これらの会話はすべて同じ場所につながります。これは、データセンターがコヒーレントな巨大なコンピューティングエンジンであり、多くの人が共有できるようにする一方で、非常に大規模なアプリケーションを実行できる人はほとんどいないという未来です。それらにも。データセンターの将来では、コンピューティングはサーバーで開始および終了するのではなく、ネットワークに拡張され、ネットワーク自体がコンピューティングファブリックの一部になると考えています。長期的には、データセンター規模のコンピューティングアーキテクチャを作成する能力があると思います。 「」

ARMは成功の準備ができています

ARMチップは世界中のほとんどのモバイルデバイスに電力を供給しているため、アーキテクチャは設計上電力効率を維持しています。アーキテクチャはライセンスアウトされているため、ARMでは複数のシリコンメーカーを検討できます。

HPCの消費電力は依然として大きな懸念事項であり、ARMを使用することでこの問題を大幅に相殺できます。ソフトウェアを使用する場合でも、Mont-Blancプロジェクトでは、ARM用に多くの科学ライブラリとツールが開発されています。これは、エコシステム全体を前進させる上で大きな役割を果たします。

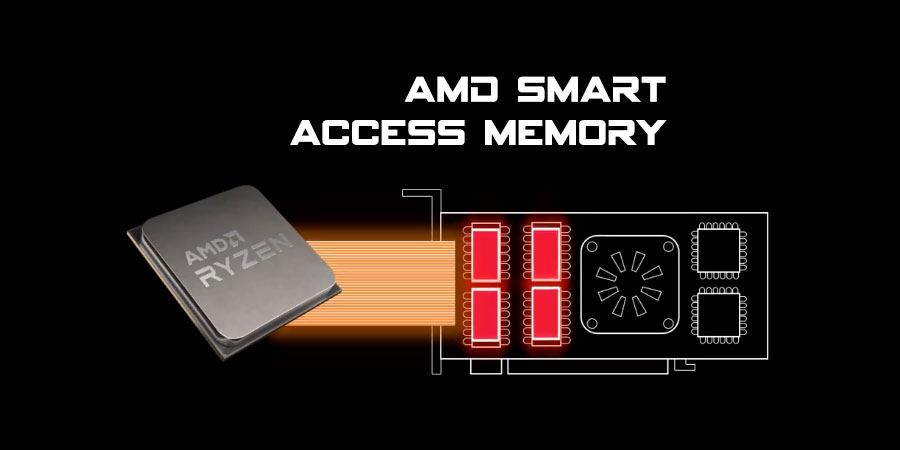

HPCおよびデータセンターでのARMの使用は、x86システムと比較してまだ小さいですが、Nvidiaはここで可能性を認識しています。彼らのライバルであるAMDも、HPCおよびデータセンター市場でEPYCサーバープロセッサおよびRadeon InstinctGPUアクセラレータと激しく競争し始めています。したがって、Nvidiaが今すぐARMを採用し、ソフトウェアスイート(CUDA-X HPCなど)を提供することが重要です。一部のメーカーとは異なり、NvidiaはCPUを製造していないため、AMDとIntelが提供できるCPU-GPUの一貫性に欠けています。

後から考えると、NvidiaはARMとのパートナーシップを強化することができます。 NextPlatform 正しく述べる「 NvidiaとArmはパートナーシップを結び、Neoverseライセンスを購入する人がNVLink IPブロックを利用できるようにし、CPU-GPUコンピューティングコンプレックス全体のメモリアトミックやメモリコヒーレンシーなど、GPUとのより緊密な結合を可能にします。 「」

この動きは、x86HPCに代わる実行可能なアーキテクチャとしてのARMのケースに間違いなく役立ちます。 AMDはRadeonInstinct GPUを積極的にプッシュし続けているため、将来的には同様の動きが期待できます。

タグ 腕 nvidia

![[修正] VKEnumeratePhysicalDevicesが失敗しました](https://jf-balio.pt/img/how-tos/13/vkenumeratephysicaldevices-failed.png)

![[修正済み] Huluエラーコード503](https://jf-balio.pt/img/how-tos/77/hulu-error-code-503.jpg)